Forschung mit KI in der Medizin - "Wenn man schlechte Daten eingibt, bekommt man auch nur schlechte Informationen"

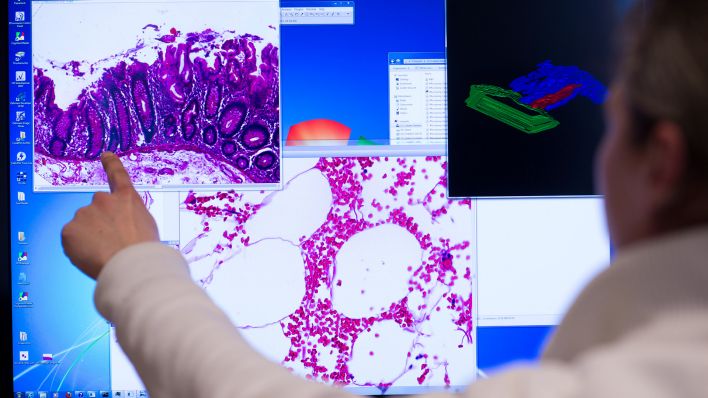

Wie kann künstliche Intelligenz bei der Behandlung von Krebs-Patienten helfen? Dazu wird an der Berliner Charité geforscht. Was sich die Experten für die Zukunft davon erhoffen, erklärt die Bioinformatikerin Manuela Benary.

rbb: Frau Benary, woran forschen Sie an der Berliner Charité?

Manuela Benary: Wir forschen am Comprehensive Cancer Center in der Charité und arbeiten am molekularen Tumorbord. Es geht darum, Patienten zu helfen, für die es keine Standardtherapien gibt. Wir schauen uns an, was in der DNA kaputt ist, also im Bauplan der Zellen im Tumor. Da gibt es verschiedenste Methoden. Und diese Fehler sind interessant, weil man sie ganz speziell mit einem Medikament angreifen kann.

Sie haben zehn fiktive Krebs-Patienten erstellt. Mehrere künstliche Intelligenzen sowie auch Mediziner sollten Therapiemöglichkeiten erstellen. Diese Ergebnisse haben Sie, ohne sie zu kennzeichnen, dann weiteren Medizinern vorgelegt. Was ist dabei rausgekommen?

Wir haben uns gedacht, lasst uns die Arbeit der Ärzte vereinfachen, denn die Ärzte wollen sich ja eigentlich mit den Patienten beschäftigen und nicht unbedingt mit Literaturrecherche. Wir haben verschiedene KIs darauf schauen lassen und sie gefragt, was sie empfehlen würden. Je nachdem, wie wir gefragt haben, fielen die Antworten der KIs auch unterschiedlich aus. Unterschiedlich waren zum Teil auch die Ergebnisse unserer ärztlichen Experten.

Und was haben die dann gesagt?

Wir haben zwei Fragen gestellt. Die erste Frage war: Was denken Sie, kommt das jetzt von der KI oder nicht? In den meisten Fällen haben sie das auch richtig entdeckt. Das heißt, der Unterschied ist wirklich eklatant. Die andere Frage war: Gibt es bei diesen Vorschlägen welche, die sinnvoll sind, die Sie vielleicht nicht bedacht haben? Und da gibt es ein paar kleine Schätze zu finden, also Querverbindungen, die man eventuell in seinem Wissen gerade nicht parat hatte.

Ist die KI auch nur ein Mensch?

Die KI ist auch nur ein Mensch, das kann man so nicht anders sagen. Das hängt auch damit zusammen, wieviel Wissen in einer KI enthalten ist. Chat-GPT hat zum Beispiel zu dem Zeitpunkt nur Wissen bis Ende 2021 gehabt. Alles, was an neuer Wissenschaft in dem Moment entstanden war, war nicht enthalten.

Haben Sie vorsortiert, welche KI schlau ist und welche nichts bringt?

Genau. Wobei wir gesagt haben: Der Mensch, also der Arzt, ist der Experte. Das ist sozusagen, wo wir hin wollen - möglichst genau dieselben Sachen finden wie der Arzt, aber nicht viel mehr. Es bringt ja nichts, wenn wir 120 Empfehlungen machen, der Arzt nur fünf und er sich dann wieder durch 120 Sachen durcharbeiten muss. Das ist keine Hilfe. KIs können zum Beispiel nicht sagen "Ich weiß es nicht". Zumindest zu dem Zeitpunkt, als wir angefangen haben.

Die KI hat einfach etwas erfunden? Eine Studie, die es nicht gibt?

Ja, das ist total verrückt. Das ist inzwischen auch anders, weil es weiterentwickelt wird. Inzwischen passiert das seltener. Wir haben dann auch geschaut: Sind die Studien auch wirklich relevant für den Bereich Krebsmedizin oder kommen sie aus einem ganz anderen Feld? Denn das kann vorkommen. Deswegen kann eine KI nur Vorschläge machen und der Arzt muss immer draufschauen und entscheiden, ob diese Information sinnvoll und hilfreich ist.

Sie finden es nicht so merkwürdig, dass die KI etwas erfindet? Jemand hat sie so programmiert, dass sie etwas erfindet? Das ist doch irre.

Das ist ja das Prinzip einer KI oder dieses Chatbots. Das sind große Modelle mit extrem vielen Stellschrauben. Das ist so, als ob Sie ein Heizungssystem haben, bei dem sie an allen möglichen Ecken und Enden irgendwie etwas einstellen können. Und eingestellt wird das durch Wissen.

Es wurden Publikationen genutzt, um diese Stellschrauben einzustellen. Aber es ist keine Entscheidung. Es gibt mehrere Möglichkeiten und das ist mit Wahrscheinlichkeiten behaftet. Das heißt, es gibt auch immer eine Möglichkeit, irgendwas anderes zu finden.

Sie müssen also noch extrem drauf schauen, damit KI uns überhaupt helfen kann?

Im Moment ist das genau der Punkt und das Spannende: Wie können wir weiteres Wissen hinzufügen? Wie können wir die Fragen so stellen, dass es sinnvoll ist? Wie können wir zusammenfassen, was wir aus einer KI herausbekommen?

Wird die KI im Moment schlauer durch das, was Sie da erforschen?

Durch das, was ich speziell erforsche, aktuell noch nicht, weil wir das Wissen noch nicht wieder hineingeben. Das wird durch zusätzliche Publikationen passieren, die immer wieder ergänzt werden.

Wie geht es denn jetzt weiter?

Wir möchten das Wissen, das sich über die letzten Jahre am Comprehensive Cancer Center angesammelt hat, natürlich auch gerne nutzen, um das zu verbessern. Das ist nur ein Baustein in dem Ganzen. Wir haben ganz viele Projekte, die darauf abzielen, das Wissen zu verbessern, um Präzisionsonkologie besser zu machen.

Das heißt, KI wird eine größere Rolle spielen. Es ist aber noch nicht klar, wie groß - und wir müssen sehr genau aufpassen, dass sie keinen Unsinn treibt?

Ja, ich denke, das ist eine sehr gute Zusammenfassung. Es ist wichtig zu schauen, welche Art Daten man eingibt. Das ist das Wichtige. Ich denke, es gibt genügend Beispiele für eine Fehleinschätzung von KI. Dessen sollte man sich immer bewusst sein. Wenn man schlechte Daten eingibt, bekommt man auch nur schlechte Informationen. Wenn man Vorurteile hineingibt, bekommt man Vorurteile heraus. Insofern ist es immer mit einer gewissen Vorsicht zu genießen. Aber ich denke, es kann uns ein Handwerk an die Hand geben, um Ärzten wirklich das Leben zu erleichtern, damit sie mehr Zeit für Patienten haben.

Haben Sie eine Vorstellung, wie weit wir in zehn Jahren damit sind, oder kann man das gar nicht sagen?

Das kann man überhaupt nicht sagen. Dass Chat-GPT letztes Jahr so dermaßen gut war, auch in der Konversation, war für einige wirklich überraschend. Wo das jetzt hinführen wird, ist sehr unklar. Es ist auch total spannend zu sehen, wie unterschiedlich damit umgegangen wird. Wir müssen ganz viele Aspekte beachten, Datenschutz, Regulation, aber auch Verbrauch. So ein Server verbraucht Unmengen an Energie. Ich habe keine Ahnung, wo es hingeht, aber das macht es spannend.

Werden Sie und Ihre Kollegen am Ende nicht ersetzt?

Ich glaube nicht, nein. Nicht in den nächsten zehn Jahren - dafür gibt es einfach noch zu viel zu verstehen, vorzubereiten und auszuwerten.

Vielen Dank für das Gespräch!

Das Interview mit Manuela Benary führte Ingo Hoppe für rbb 88,8.

Der Text ist eine gekürzte und redaktionell bearbeitete Fassung. Das Interview können Sie auch oben im Audio-Player nachhören.

Sendung: rbb 88,8, 09.04.2024, 18:10 Uhr